こんにちは。ひらみんです。

テーマに惹かれて2023年5月8日のオンライン哲学バーに参加しました。

今回のテーマは、世間を騒がせている、あの「ChatGPT」です。

ChatGPTを使ったことのある人も、ない人も、

AIに詳しい人も、詳しくない人も、今やその名を聞いたことないという人はいないんじゃないでしょうか。

ChatGPTとは、“AIの一種で、人間と自然な会話ができるプログラムのこと”ーーAIとChatGPTの関係はこんな感じでご理解いただけたらと良いのだと思います。

「AIが人間の仕事を奪う」と言われて、私たちライターの仕事もAIに取って代わられる仕事のひとつだと言われています。そんな中で、人間のライターにしかできないことってなんでしょうか。私にとっては、危機迫るテーマが設定された哲学バーでした。

今回の記事は、哲学バーをきっかけに「人間にしかできないことってなんだろう」って考え続けた私なりの考察になりました。

AIについて考える旅に一緒に出かけませんか。

AIってなんだろう

私はデジタル技術の専門家ではないので、まずはChatGPTにAIについて質問してみました。

ひらみ:AIってなんですか

ChatGPT:AIは「人工知能」(Artificial Intelligence)の略称です。AIは、人間の知能や認知能力を模倣・再現し、機械やコンピュータによって実現される技術やシステムを指します。

ひらみ:小学5年生でもわかるように教えて

ChatGPT:AIは「人工知能」のことで、コンピューターが人間のように考えたり学んだりする技術のことです。AIは、たくさんの情報を使って問題を解いたり、決定をしたりすることができます。

人間のように考えたり、学んだりできるという点が、「人間の仕事がAIに取って代わる」と言われる理由なのかもしれません。

AIとはなんぞや、という点については、哲学バーの中で「人工知能は、過去のデータの蓄積である」とも教えてもらいました。そして、「AIは車だと理解したらいい」という考えがあるそうです。私たちは、うまく運転して、正しく使いこなすことが必要なんだと改めて感じました。

また、「車は早く目的地に行ける」という点が、「聞いたことにすぐ答えが返ってくる」というところに感じられて、車というイメージがしっくりくる、という声もありました。

哲学バーのあと、さらに思い巡らせていたら、「仕組みがわからなくても使えるという点も似てるな」と思ったり、AIは善悪の判断をしないので、「使い方を間違えると危ない」という点でも、「AIは車である」という考えが、私の中で、ますます納得のいくものとなったのでした。

「過去のデータの蓄積」という意味

哲学バーで、AIは膨大な過去のデータだと学びました。実際に、現時点で無料版のChatGPTには2021年までのデータが入っています。だけど、記事執筆時では過去となっている大谷選手やヌートバー選手が大活躍した2023年のワールドベースボールクラシックの結果は教えてくれません。入っているデータよりも未来のことは知らないのです。

人間にできて、過去のデータであるAIにできないことについて、最初、私は、AIは新しいことを作り出せないんじゃないかと思っていました。でも、哲学バーの中で、既存のもの同士の掛け合わせて、新しい物を作り出すことができる、という視点を伺い、たしかにそれがイノベーションか、と納得したのでした。

調べたら、手塚治虫の漫画を元データとして、AIが自動生成したものを、人間が漫画にする、という「TEZUKA2020」というプロジェクトがありました。

AIと人間のコラボとはいえ、「ぱいどん」という手塚治虫の新作が21世紀に生まれていました。

人間にしかできないことってなんだろう、と考えながらお風呂に入っていたら、ふと思ったんです。

遠い昔、人類は天動説が正しいと思っていましたよね。でも16世紀にコペルニクスは、それこそ「コペルニクス的転回」で地動説を唱えて、今ではそれが正しい説として認められています。

もし仮に、天動説が正しいというデータしか入ってなかった場合、今のAIが自ら地動説を導き出すことはできないんじゃないでしょうか。なぜなら、過去の常識しか入っていないのですから。地動説が正しくても、その概念がなければ、AIは地動説を出せないのではないかと思います。

その時に正しいと言われている常識をひっくり返すほどの新しい説を生み出すことは、今のAIにはできないんじゃないか、と思い始めました。

AIにできないことをするには

じゃぁ、コペルニクスのような歴史に残る天才的な頭脳を持つ人だけが、AIに勝つことができるんでしょうか。私はそうじゃないと思います。

コペルニクスが地動説にたどり着く前に、まず「天動説は正しいのか?」と、最初に天動説に疑問を持ったんだと思うんです。ここに、答えがあるような気がしました。

そう、「AIは、疑うことができない」のではないでしょうか。

AIは膨大なデータの蓄積で、これまで常識だと思われている考えなどが入っているだけで、

善悪を決めないし、自分自身の意見や判断を持ちません。

だから、ChatGPTから返ってくる答えが正しいのか判断するのは、使う側の人間です。

そう思ったら急に、これまでスタンダードや常識だと思われていたことなどを疑って、立ち止まって考えることは、人間にしかできないのではないか、という考えが降りてきました。

同時に、それって、とってもエラマ的だなと思ったんです。

社会や世間が決めた幸せと、わたしが感じる幸せは同じなのか、疑って、他人が作った理想像を追い求めるんじゃなくて、「ありたい姿」を自分で考えて作ることはAIにはできないと思います。

AIにできなくて、人間にしかできないことを考えたら、エラマの原点に戻ってきました。

エラマはAIに勝てるかもしれない、と思ったら、エラマ的な思考を持つ人は、これからの時代も生き抜いていける!と根拠のない自信がわいてきました。

AIを使いこなすという姿勢で

AIはこれからもどんどん進化していきます。それと同じ速度で、というのは人間には無理ですが、私たちもAIを正しく使うために進化していかなきゃいけない、とも思います。

でも、しばらく、人間はAIに勝てると思います。

私がたどり着いた答えは、今の私が思うことです。ChatGPTがバズっている今、みなさんが考える「人間にしかできないこと」はなんでしょうか。ぜひお聞かせください。

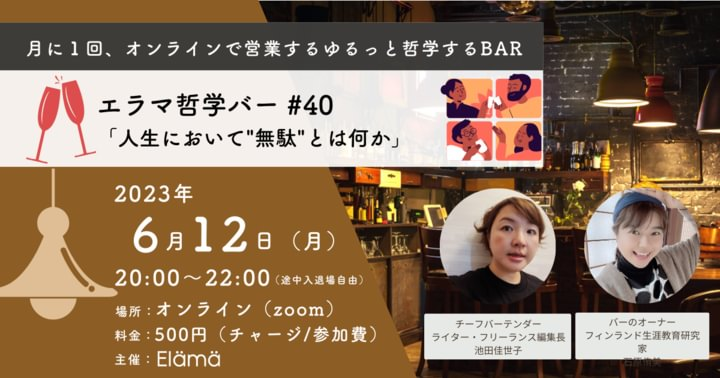

哲学バーでは、全員が納得するような答えとして、ひとつにまとめたり、総括したりしません。誰もが独自のアイデアを持ち、自由に発言できて、相手の考えを否定しないところが、私はとても気に入っています。

興味をお持ちいただければ、哲学バーにぜひお越しください。次回は2023年6月12日(月)で、第40回のテーマは「人生において”無駄”とはなにか」です。

お申し込みはこちらから

ぜひ、お酒片手にオンラインでお会いしましょう!

Text by ひらみなおこ(ふつうの会社員)